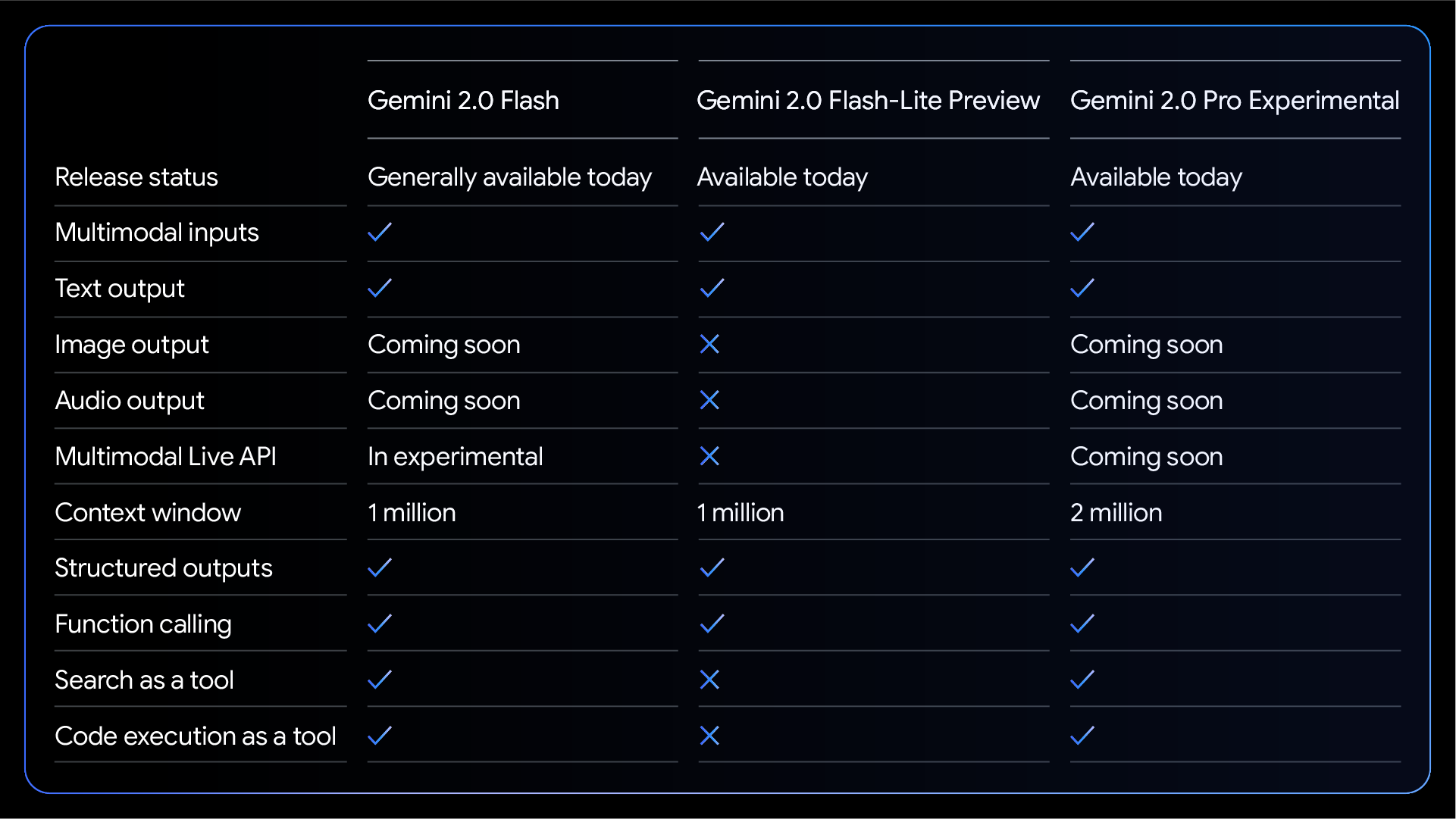

本日、エキサイティングなアップデートをお知らせしました。本番環境で Gemini 2.0 を利用できるデベロッパーを拡大します。Google AI Studio の Gemini API、または Vertex AI で、以下のモデルを利用できます。

回答する前に理由を考える Flash バリアントである Gemini 2.0 Flash Thinking Experimental も最近公開しました。それに今回のリリースが加わったことで、さらに多くのユースケースやアプリケーションで Gemini 2.0 が利用できるようになります。

Gemini 2.0 Flash は、ネイティブ ツールの利用、100 万トークンのコンテキスト ウィンドウ、マルチモーダル入力など、包括的な機能を提供します。現在はテキスト出力に対応しており、今後数か月以内に、画像や音声の出力機能、Multimodal Live API が一般提供される予定です。Gemini 2.0 Flash-Lite は、大規模テキスト出力のユースケースに向けてコストが最適化されています。

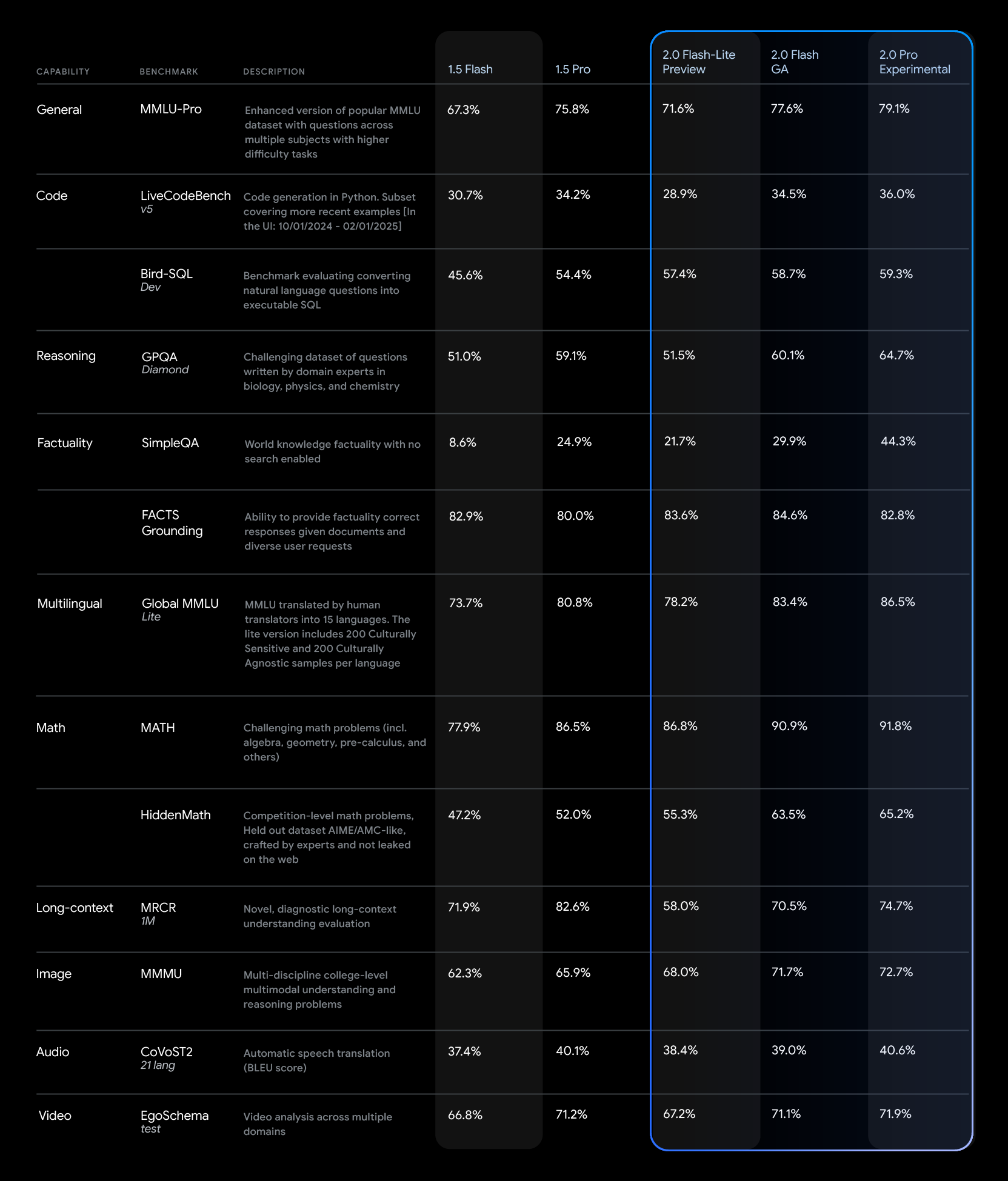

Gemini 2.0 モデルは、さまざまなベンチマークで Gemini 1.5 よりも大幅にパフォーマンスが向上しています。

これまでのモデルと同じく、Gemini 2.0 Flash はデフォルトで簡潔なスタイルを使うようになっているため、使いやすさとコスト削減を実現できます。プロンプトを使って冗長なスタイルを求めることもできます。これにより、チャット指向のユースケースで結果が向上します。

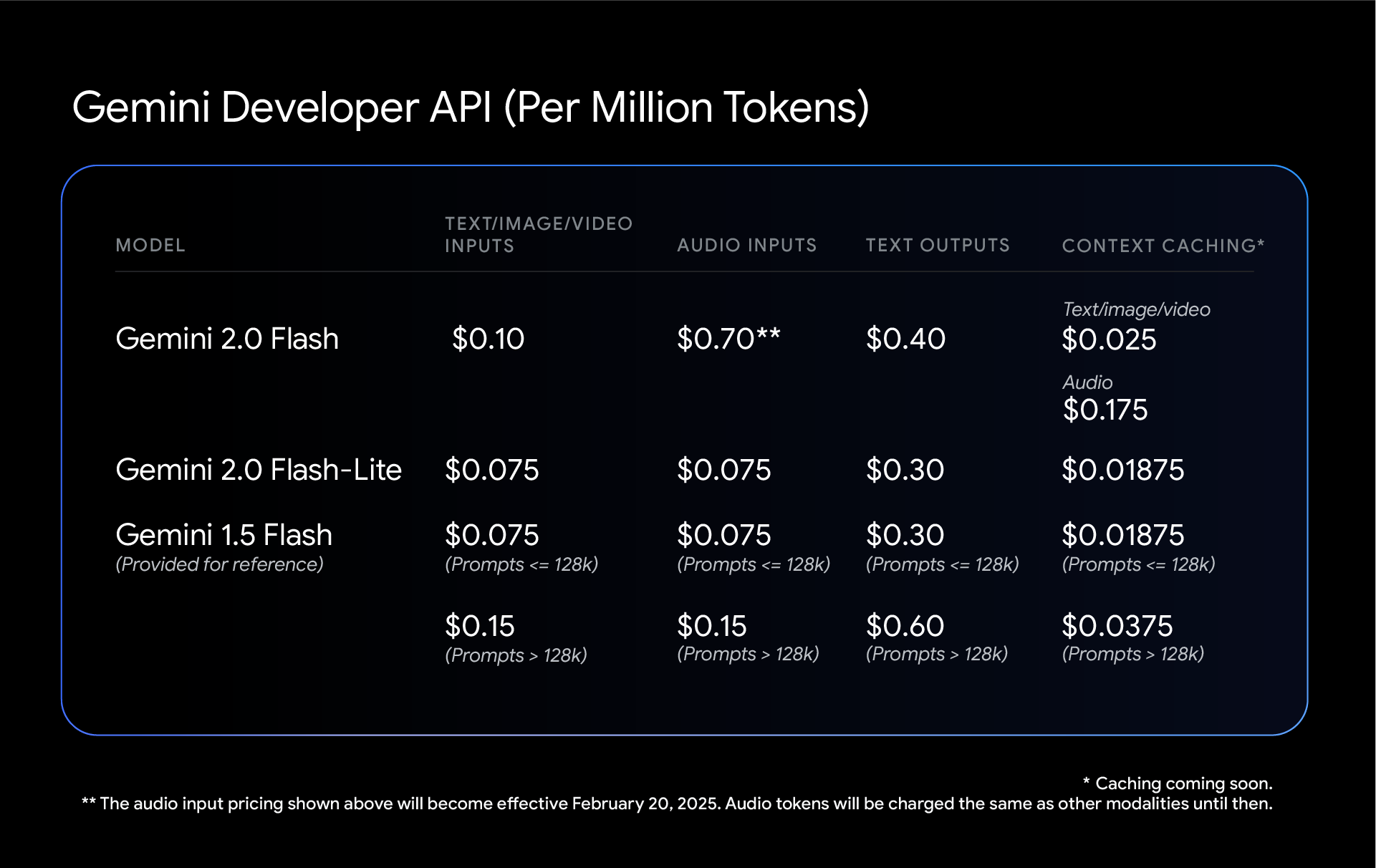

Gemini 2.0 Flash と 2.0 Flash-Lite では、引き続き料金を引き下げます。どちらも入力タイプごとに価格が決まり、Gemini 1.5 Flash に適用されていたコンテキスト要求の長さに応じた料金区分はなくなります。つまり、2.0 Flash と Flash-Lite では、どちらもパフォーマンスが向上しているにもかかわらず、Gemini 1.5 Flash でコンテキストが混在したワークロードを扱う場合よりも安価になる可能性があります。

さまざまなモダリティでのトークンの数え方、Gemini Developer API の価格設定、Vertex AI の価格設定の詳細は、各リンクをご覧ください。

最新の Gemini モデルは、4 行のコードから開発を始めることができます。業界をリードする無料枠とレート制限を活用し、本番環境にスケーリングしましょう。私たちはこれまでの皆さんの進展に触発されています。皆さんが最新の Gemini モデルで作るものを見るのが待ちきれません。楽しい開発を!