오늘 저희는 프로덕션 준비를 마치고 업데이트된 두 Gemini 모델, Gemini-1.5-Pro-002와 Gemini-1.5-Flash-002를 출시합니다. 주목할 만한 특징은 다음과 같습니다.

최신 실험용 모델 버전을 기반으로 한 이 새로운 모델은 지난 5월에 Google I/O에서 공개된 Gemini 1.5 모델에 대한 의미 있는 개선 사항을 포함하고 있습니다. 개발자는 Google AI Studio와 Gemini API를 통해 최신 모델에 무료로 액세스할 수 있습니다. 대규모 조직과 Google Cloud 고객의 경우 Vertex AI에서도 해당 모델을 사용할 수 있습니다.

Gemini 1.5 시리즈는 광범위한 텍스트, 코드 및 멀티모달 작업에서 일반적인 성능을 발휘하도록 설계된 모델입니다. 예를 들어, Gemini 모델을 사용하여 1,000페이지 분량의 PDF 파일 정보를 종합 정리하고, 10,000줄 이상의 코드가 포함된 리포지토리에 대한 질문에 답변하고, 1시간 분량의 동영상을 가져와 이를 활용해 유용한 콘텐츠를 만드는 등의 작업을 할 수 있습니다.

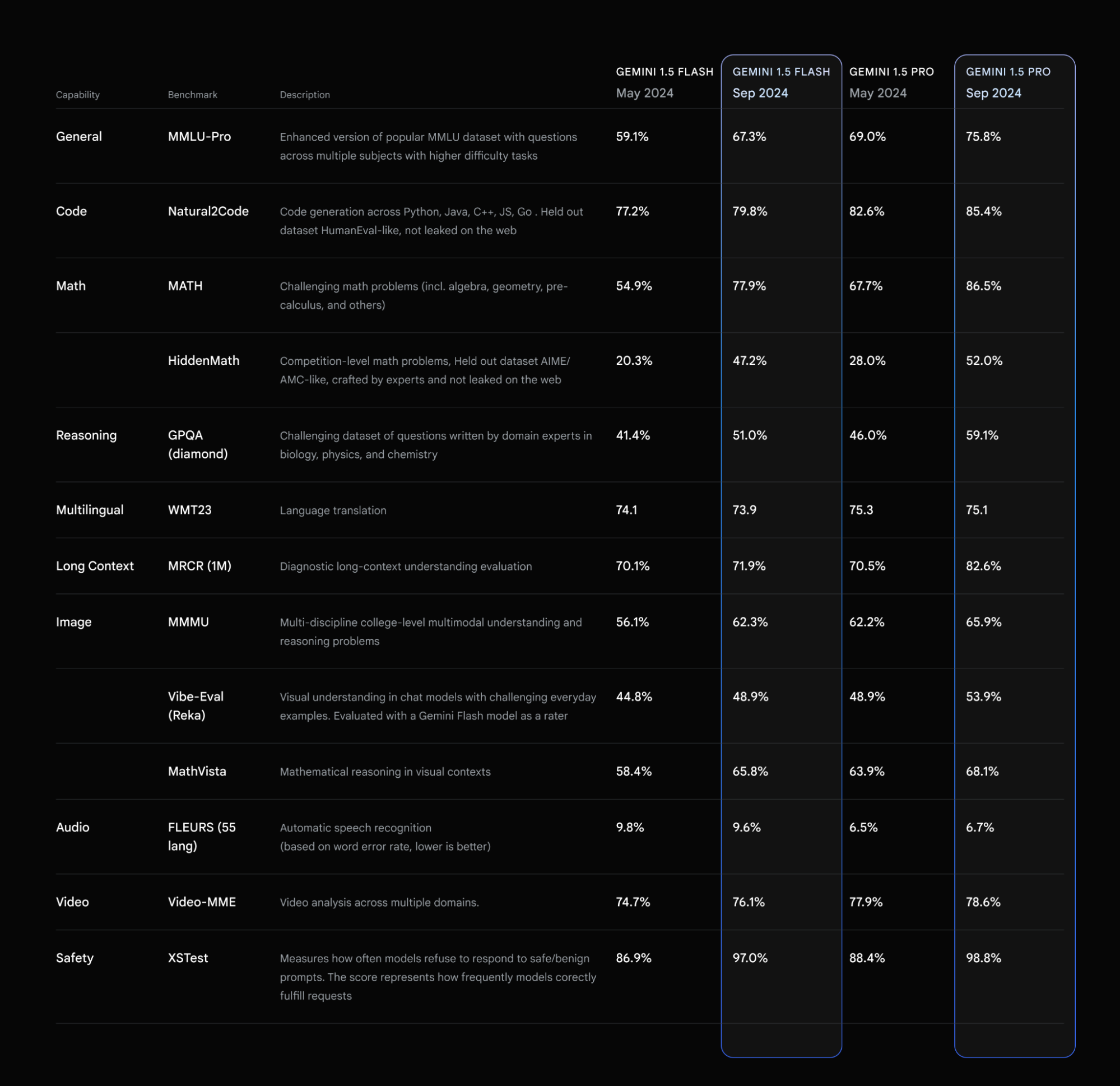

최신 업데이트를 통해 1.5 Pro와 Flash는 이제 프로덕션 환경에서 개발할 때 더 우수하고 더 빠르며 더 비용 효율적입니다. 널리 쓰이는 MMLU 업계 기준치의 더욱 도전적 버전인 MMLU-Pro에서 수치가 약 7% 향상되었고, MATH 및 HiddenMath(수학 경시대회 문제의 내부 홀드아웃 세트) 업계 기준치에서는 두 모델 모두 약 20%에 달하는 큰 개선을 이루었습니다. 비전 및 코드 사용 사례에서도 두 모델 모두 시각적 이해와 Python 코드 생성을 측정하는 평가에서 더 나은 성능(약 2~7% 범위)을 발휘합니다.

또한 콘텐츠 안전 정책과 기준을 지속적으로 준수하면서 모델 응답의 전반적인 유용성을 개선했습니다. 이는 많은 주제 전반에서 응답의 회피/거절 횟수는 더 적어지고 도움이 되는 응답이 더 많아짐을 의미합니다.

두 모델 모두 개발자 피드백에 따라 이제 스타일이 더 간결해졌습니다. 이는 이러한 모델을 더 쉽게 사용하고 비용을 절감하기 위한 노력의 일환입니다. 요약, 질문 답변, 추출과 같은 사용 사례의 경우 업데이트된 모델의 기본 출력 길이는 이전 모델보다 약 5~20% 더 짧습니다. 사용자가 기본적으로 더 긴 응답을 선호할 수 있는 채팅 기반 제품의 경우, 프롬프트 전략 가이드를 통해 보다 상세한 응답을 대화체로 제공하는 모델을 만드는 방법에 대해 자세히 알아볼 수 있습니다.

최신 버전의 Gemini 1.5 Pro 및 1.5 Flash로 마이그레이션하는 방법에 대한 자세한 내용은 Gemini API 모델 페이지를 참조하세요.

Gemini 1.5 Pro의 2백만 개 토큰 길이의 컨텍스트 윈도우와 멀티모달 기능을 기반으로 한 창의적이고 유용한 여러 애플리케이션은 끝없는 감탄을 자아냅니다. 동영상 이해부터 1,000페이지 분량의 PDF 파일 처리까지, 아직 구축해야 할 새로운 사용 사례가 너무나 많습니다. 가장 강력한 1.5 시리즈 모델인 Gemini 1.5 Pro의 증분 캐시 토큰에 대한 64%의 가격 인하, 입력 토큰에 대한 64%의 가격 인하, 출력 토큰에 대한 52%의 가격 인하를 오늘 발표합니다. 이는 2024년 10월 1일부터 토큰 수 128,000개 미만인 프롬프트에 대해 적용됩니다. 컨텍스트 캐싱과 함께, 이를 통해 Gemini를 사용한 개발 비용을 앞으로도 계속 절감할 수 있습니다.

개발자가 Gemini로 훨씬 더 쉽게 개발할 수 있도록 1.5 Flash의 유료 등급 속도 제한을 1,000RPM에서 2,000RPM으로, 1.5 Pro는 360RPM에서 1,000RPM으로 각각 상향 조정합니다. 개발자가 Gemini로 더 많은 것을 개발할 수 있도록 앞으로 몇 주 동안 Gemini API 속도 제한을 계속 높일 것으로 기대합니다.

최신 모델에 대한 핵심 개선 사항과 더불어, 저희는 지난 몇 주 동안 1.5 Flash로 지연 시간을 줄이고 초당 출력 토큰 수를 대폭 늘려 Google의 가장 강력한 모델로 새로운 사용 사례를 지원했습니다.

2023년 12월에 Gemini가 처음 출시된 이래, 안전하고 신뢰할 수 있는 모델 개발은 저희의 핵심 과제였습니다. 이번 Gemini 최신 버전(-002 모델)을 통해 모델이 안전의 균형을 유지하면서 사용자 지침을 따르도록 모델을 개선할 수 있었습니다. 앞으로도 개발자가 Google 모델에 적용할 수 있는 안전 필터 모음을 계속 제공하겠습니다. 오늘 출시된 모델의 경우, 개발자가 자신의 사용 사례에 가장 적합한 구성을 결정할 수 있도록 필터가 기본으로 적용되지 않습니다.

8월에 발표된 Gemini 1.5 모델의 향상된 버전인 "Gemini-1.5-Flash-8B-Exp-0924"가 출시됩니다. 이 향상된 버전은 텍스트 및 멀티모달 사용 사례 모두에서 성능이 크게 증대되었습니다. 현재 Google AI Studio와 Gemini API를 통해 제공됩니다.

개발자 여러분이 1.5 Flash-8B에 대해 공유해 주신 피드백은 긍정적인 내용이 압도적으로 많았습니다. 정말 놀라운 결과입니다. 저희는 개발자 피드백을 기반으로 실험용 버전에서 프로덕션 출시 파이프라인을 계속해서 만들어 나가겠습니다.

오늘 여러 업데이트를 소개해 드릴 수 있어 매우 기쁘게 생각하며 개발자 여러분이 새로운 Gemini 모델로 무엇을 개발하실지 정말 기대됩니다! Gemini Advanced 사용자는 곧 Gemini 1.5 Pro-002의 채팅 최적화 버전에 액세스할 수 있을 것입니다.