저희는 개발자로서 이미지 작업에 익숙합니다. 반려동물을 인식하고 제품을 분류하고 예술 작품을 생성하는 앱을 개발합니다. 하지만 대부분의 시간 동안은 RGB, 즉 삼원색인 빨간색, 녹색, 파란색의 세상에서 살고 있습니다. 이것이 바로 인간의 눈과 카메라가 세상을 보는 방식입니다.

하지만 애플리케이션에 초인적 시각을 제공할 수 있다면 어떨까요? 인간의 눈에 보이지 않는 파장으로 볼 수 있게 되어 근본부터 새로운 방식으로 세상을 이해할 수 있다면 어떨까요?

그것이 바로 다중 스펙트럼 이미지의 힘입니다. 그리고 Google Gemini 모델의 네이티브 멀티모달 기능 덕분에 그 어느 때보다 쉽게 그 힘을 활용할 수 있습니다. 더 이상 맞춤형으로 학습된 특수 모델은 필요하지 않습니다. 복잡한 위성 데이터 분석도 즉시 시작할 수 있습니다.

일반적인 디지털 사진을 생각해 보세요. 각 픽셀은 R, G, B의 세 가지 값으로 구성됩니다. 다중 스펙트럼 센서는 초강력 카메라와 같습니다. 단 세 개의 대역만 포착하는 대신, NIR(근적외선)과 SWIR(단파 적외선)처럼 인간의 눈으로는 볼 수 없는 대역을 포함해 전자기 스펙트럼의 다양한 대역에 걸친 데이터를 수집합니다.

과거에는 이러한 데이터를 사용하려면 전문 도구, 복잡한 데이터 처리 파이프라인, 맞춤형 머신러닝 모델이 필요했습니다. 그러나 Google의 연구 논문에서 설명한 것처럼 이제는 Gemini가 놀랍도록 간단한 기법으로 이 풍부한 데이터에 강력한 추론 엔진을 활용할 수 있도록 지원함으로써 이 분야를 혁신하고 있습니다.

다른 대형 멀티모달 모델과 마찬가지로, Gemini는 이미지와 텍스트로 구성된 방대한 데이터 세트로 사전 학습됩니다. Gemini는 '빨간색 자동차'나 '녹색 숲'이 무엇인지 이해합니다. Gemini가 다중 스펙트럼 데이터를 이해하도록 만드는 열쇠는 인간이 관심을 갖는 비가시 대역을 Gemini가 이미 이해하고 있는 R, G 및 B 채널로 매핑하는 것입니다.

말하자면, '위색 합성(FCC)' 이미지를 만듭니다. 즉, 그 이미지가 자연스럽게 보이게 만드는 것이 아니라 과학 데이터를 모델이 처리할 수 있는 형식으로 인코딩하는 것입니다.

이를 위한 간단한 3단계 절차는 다음과 같습니다.

2. 정규화 및 매핑: 각 대역의 데이터를 0~255 범위의 표준 정수로 조정하고, 이를 새 이미지의 R, G, B 채널에 할당합니다.

3. 컨텍스트를 포함한 프롬프트 작성: 이렇게 생성된 이미지를 Gemini로 전달하는데, 특히 중요한 점은 프롬프트 작성 시 각각의 색이 무엇을 나타내는지 알려주어야 합니다.

이 마지막 단계는 마법과 같습니다. 사실상 프롬프트 작성자가 모델에게 실시간으로 자신만의 새로운 맞춤형 이미지를 어떻게 해석할지 가르치는 셈입니다.

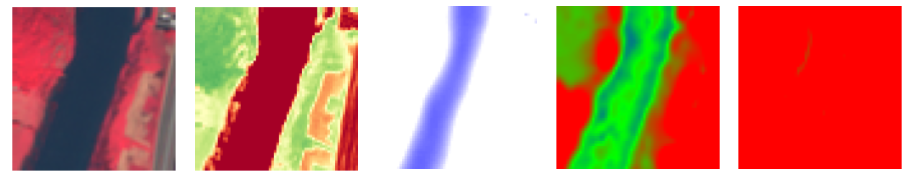

Gemini 2.5는 매우 다재다능하며 이미 원격 탐사에서 매우 뛰어난 성능을 보이고 있습니다. 예를 들어, 아래 이미지들은 토지 피복 분류를 위해 EuroSat 데이터 세트에서 가져온 것으로 Gemini 2.5는 성공적으로 이를 이해하여 각각 영구 작물, 강, 산업 지역으로 정확하게 분류합니다.

그러나 분류가 어려운 상황에서는 RGB 이미지만으로 충분한 정보를 얻지 못할 수도 있습니다. 예를 들어, 아래는 강의 모습을 담은 이미지인데, 모델이 처음에는 숲으로 잘못 분류했습니다.

아래와 같이 다중 스펙트럼 유사 이미지를 도입 및 구성하고, 논문에서 설명했듯이 상세한 프롬프트를 작성한 후에 Gemini 2.5는 위 이미지를 강으로 올바르게 인식했습니다. 그 추론 과정을 추적해 보면, 모델이 다중 스펙트럼 입력, 특히 NDWI(정규화 된 차이 물 지수) 이미지를 활용하여 위 이미지가 강물이라고 판단했음을 알 수 있습니다.

또 다른 예로, 아래에 있는 숲의 이미지에서 이 모델은 처음에 파란색/녹색 영역을 근거로 추론하여 이를 바다나 호수로 분류했습니다.

하지만 다중 스펙트럼 입력 데이터를 포함했더니 모델이 해당 이미지를 쉽게 숲으로 분류했으며, 추론 추적을 통해 모델이 추가 입력 데이터를 상당히 크게 활용한다는 점을 알 수 있습니다.

이러한 여러 예시에서 보듯, 추가적인 다중 스펙트럼 입력이 더 나은 결정을 내리는 데 중요하다는 점은 분명합니다. 또한 모델을 변경할 필요가 없으므로 동일한 방식으로 다른 유형의 입력을 추가할 수 있습니다.

새로운 다중 스펙트럼 입력과 함께 Gemini 2.5를 사용하는 방법을 보여주는 예로 Colab 노트북을 준비했습니다. 이제 Gemini 2.5로 자신만의 원격 탐사를 시도할 수 있습니다.

이 접근 방식은 개발자에게 획기적인 도구로서, 복잡한 위성 데이터 분석의 진입 장벽을 크게 낮춰줍니다. 원격 탐사에 대한 깊은 전문 지식이 없어도 몇 주가 아닌 단 몇 시간 만에 새로운 애플리케이션의 프로토타입을 빠르게 제작할 수 있습니다. Gemini의 강력한 컨텍스트 기반 학습 능력 덕분에 개발자는 맞춤 이미지와 함께 명확한 프롬프트를 제공하는 것만으로 농업 모니터링부터 도시 계획에 이르기까지 다양한 작업에 필요한 서로 다른 스펙트럼 데이터를 해석하는 방법을 모델에 동적으로 지시할 수 있습니다.

AI를 활용한 환경 모니터링, 정밀 농업, 재난 대응의 시대가 도래했습니다. Gemini와 함께하면 이러한 강력한 도구를 바로 여러분의 손에 넣을 수 있습니다. NASA의 Earthdata, Copernicus Open Access Hub 또는 Google Earth Engine과 같은 소스에서 공개 위성 데이터를 가져와 여러분의 앱이 완전히 새로운 시각으로 세상을 볼 수 있도록 학습시켜 보세요.

연구를 수행한 Ganesh Mallya, Yotam Gigi, Dahun Kim, Maxim Neumann, Genady Beryozkin, Tomer Shekel, Anelia Angelova 및 모든 저자와 공동작업자에게 감사의 말씀드립니다. 또한 많은 도움과 지원을 해주신 Nikita Namjoshi, Lauren Usui, Omar Sanseviero, Logan Kilpatrick, Rohan Doshi, Amanda Stanton, Abhijit Ogale, Radu Soricut, Jean-Baptiste Alayrac, AJ Piergiovanni, Justin Burr, Brian Gabriel, Jane Park, Marlo Colinas Vaughan, Vishal Dharmadhikari, Claire Cui, Zoubin Ghahramani 분들께도 감사드립니다.