46 결과

2025년 11월 19일 / AI

Jules, an always-on, multi-step software development agent, now features Gemini 3, offering clearer reasoning and better reliability. Recent improvements include parallel CLI runs, a stable API, and safer Git handling. Upcoming features include directory attachment without GitHub and automatic PR creation. Jules aims to reduce software writing overhead so developers can focus on building.

2025년 11월 18일 / AI

Gemini 3 Pro is now integrated into Gemini CLI, unlocking state-of-the-art reasoning, agentic coding, and advanced tool use for enhanced developer productivity. It's available now for Google AI Ultra and paid Gemini API key subscribers (upgrade CLI to 0.16.x). Features include generating 3D apps and code from visual sketches, running complex shell commands, creating documentation, and debugging live Cloud Run services.

2025년 11월 13일 / AI

Metrax is a high-performance JAX-based metrics library developed by Google. It standardizes model evaluation by offering robust, efficient metrics for classification, NLP, and vision, eliminating manual re-implementation after migrating from TensorFlow. Key strengths include parallel computation of "at K" metrics (e.g., PrecisionAtK) for multiple K values and strong integration with the JAX AI Stack, leveraging JAX's performance features. It is open-source on GitHub.

2025년 11월 7일 / AI

The Agent Development Kit (ADK), an open-source, code-first toolkit for building powerful and sophisticated AI agents, now supports Go. ADK moves LLM orchestration and agent behavior directly into your code, giving you robust debugging, versioning, and deployment freedom. ADK for Go is idiomatic and performant, leveraging Go's strengths, and includes support for over 30+ databases and the Agent-to-Agent (A2A) protocol for collaborative multi-agent systems. Start building today!

2025년 10월 29일 / AI

Introducing the Jules extension for Gemini CLI, an autonomous sidekick for developers. It accelerates coding workflows by offloading tasks like asynchronous work, bug fixes, and changes in new branches to Jules, while you stay in flow with Gemini CLI. Get started by installing the extension and using the /jules command to initiate and check task statuses.

2025년 10월 8일 / Web

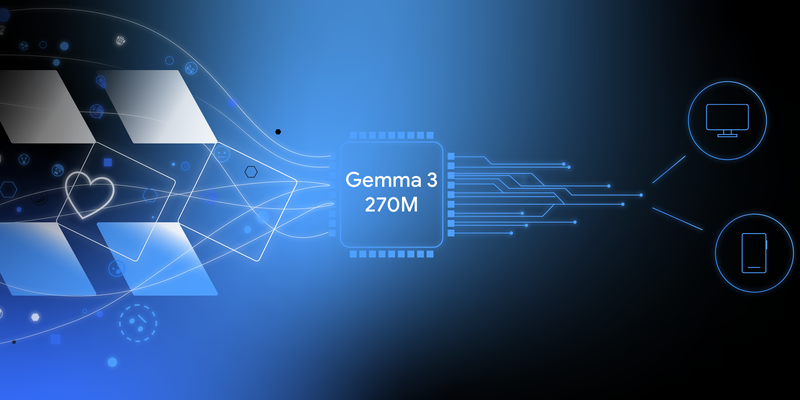

이 가이드에서는 이모티콘 변환기 같은 사용자 설정 작업을 위해 Gemma 3 270M 모델을 파인 튜닝하는 방법을 설명합니다. 온디바이스 사용을 위해 모델을 양자화 및 변환하고, MediaPipe나 Transformers.js로 웹 앱에 모델을 배포하는 방법에 대해 알아보세요. 이를 통해 빠르고 개인적이며 오프라인에서 사용 가능한 사용자 경험을 구현할 수 있습니다.

2025년 10월 7일 / AI

대규모 모델을 학습시킬 때 생길 수 있는 데이터 병목 현상을 방지하기 위해, 이 가이드는 고성능 데이터 파이프라인 구축을 위한 Grain과 ArrayRecord를 소개합니다.

2025년 10월 1일 / AI

Google Home은 파트너사의 기기를 위해 새로운 Gemini 기반 기능을 지원하고, 파트너사가 차세대 AI 카메라를 개발하는 데 도움이 되는 새로운 프로그램을 선보입니다.

2025년 9월 26일 / AI

API가 없으면 AI/에이전트도 없습니다!많은 사용자가 매일 생성형 AI와 상호작용하면서도 이러한 강력한 기능에 액세스하는 데 기본 API가 얼마나 중요한 역할을 하는지 인지하지 ...

2025년 9월 26일 / AI

AG-UI를 사용해 ADK Agents를 세련된 프런트엔드와 결합해 사용자 만족도 향상생성형 AI 애플리케이션 개발자들에게 지난해는 엄청난 발전이 몰아친 한 해였습니다. 저희는 복...