168 結果

2025年7月17日 / Gemini

Veo 3, Google’s latest AI video generation model, is now available in paid preview via the Gemini API and Google AI Studio. Unveiled at Google I/O 2025, Veo 3 can generate both video and synchronized audio, including dialogue, background sounds, and even animal noises. This model delivers realistic visuals, natural lighting, and physics, with accurate lip syncing and sound that matches on-screen action.

2025年7月16日 / Cloud

The Marin project aims to expand the definition of 'open' in AI to include the entire scientific process, not just the model itself, by making the complete development journey accessible and reproducible. This effort, powered by the JAX framework and its Levanter tool, allows for deep scrutiny, trust in, and building upon foundation models, fostering a more transparent future for AI research.

2025年7月16日 / Gemini

The updated Agent Development Kit (ADK) simplifies and accelerates the process of building AI agents by providing the CLI with a deep, cost-effective understanding of the ADK framework, allowing developers to quickly ideate, generate, test, and improve functional agents through conversational prompts, eliminating friction and keeping them in a productive "flow" state.

2025年7月14日 / Gemini

The Gemini Embedding text model is now generally available in the Gemini API and Vertex AI. This versatile model has consistently ranked #1 on the MTEB Multilingual leaderboard since its experimental launch in March, supports over 100 languages, has a 2048 maximum input token length, and is priced at $0.15 per 1M input tokens.

2025年7月10日 / Gemini

GenAI Processors は、Google DeepMind の新しいオープンソース Python ライブラリです。入力処理からモデル呼び出しと出力処理までのすべてのステップに一貫した「Processor」インターフェースを提供することで、シームレスなチェーンと同時実行を実現します。特にマルチモーダル入力を処理し、リアルタイムの応答性を必要とする AI アプリケーションの開発を簡素化します。

2025年7月10日 / Cloud

Firebase Studio のアップデートには、新しく登場したエージェント モード、Model Context Protocol(MCP)の基本サポート、Gemini CLI 統合などが含まれています。こうしたすべての機能は AI を活用した開発を再定義するものであり、デベロッパーは単一のプロンプトからフルスタック アプリケーションを作成し、強力な AI 機能をワークフローに直接統合できます。

2025年7月9日 / Gemma

エンコーダ-デコーダ LLM の新しいファミリーである T5Gemma は、Gemma 2 フレームワークをベースに、事前トレーニング済みのデコーダのみのモデルを変換して適応させることによって開発されています。要約や翻訳など、入力を深く理解する必要があるタスクにおいて、デコーダのみのモデルよりも優れたパフォーマンスと効率を発揮します。

2025年7月7日 / Gemini

Gemini API の新しいバッチモードは高スループット、遅延のない重大な AI ワークロード、スケジュールとプロセスの処理による大規模なジョブの簡素化のために設計されています。さらにデータ分析、バルク コンテンツの作成、よりコスト効率を高めてスケーラブルに行うモデル評価といったタスクの作成も可能で、デベロッパーは大容量のデータを効率的に処理できます。

2025年6月26日 / Gemma

これまでの Gemma モデルの成功をもとに、Gemma 3n モデルが完全リリースを迎えました。前例のないパフォーマンスを発揮する先進的なオンデバイス マルチモーダル機能を、エッジデバイスで利用できるようになります。モバイルファースト アーキテクチャ、MatFormer テクノロジー、Per-Layer Embeddings、KV キャッシュ共有、新しい音声エンコーダと MobileNet-V5 ビジョン エンコーダなど、Gemma 3n のイノベーションをご覧ください。デベロッパーが今すぐ開発を始める方法も紹介します。

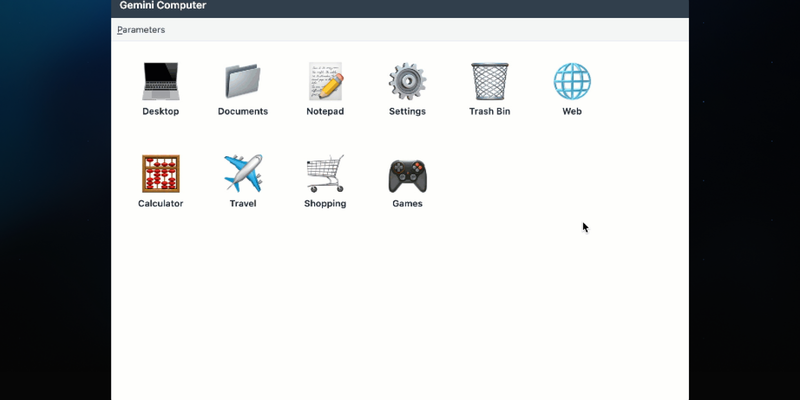

2025年6月25日 / Gemini

Gemini 2.5 Flash-Lite を使ってニューラル オペレーティング システムをシミュレーションする研究プロトタイプにより、ユーザーのインタラクションにリアルタイムで適応する UI を生成します。これは、インタラクションを追跡してコンテキストを認識したり、速度を上げるために UI をストリーミングしたり、インメモリ UI グラフを使ってステートフルを実現したりすることで可能になります。