217 結果

2025年7月10日 / Gemini

GenAI Processors is a new open-source Python library from Google DeepMind designed to simplify the development of AI applications, especially those handling multimodal input and requiring real-time responsiveness, by providing a consistent "Processor" interface for all steps from input handling to model calls and output processing, for seamless chaining and concurrent execution.

2025年7月10日 / Cloud

Updates in Firebase Studio include new Agent modes, foundational support for the Model Context Protocol (MCP), and Gemini CLI integration, all designed to redefine AI-assisted development allow developers to create full-stack applications from a single prompt and integrate powerful AI capabilities directly into their workflow.

2025年7月9日 / Gemma

T5Gemma is a new family of encoder-decoder LLMs developed by converting and adapting pretrained decoder-only models based on the Gemma 2 framework, offering superior performance and efficiency compared to its decoder-only counterparts, particularly for tasks requiring deep input understanding, like summarization and translation.

2025年7月7日 / Gemini

Gemini API の新しいバッチモードは高スループット、遅延のない重大な AI ワークロード、スケジュールとプロセスの処理による大規模なジョブの簡素化のために設計されています。さらにデータ分析、バルク コンテンツの作成、よりコスト効率を高めてスケーラブルに行うモデル評価といったタスクの作成も可能で、デベロッパーは大容量のデータを効率的に処理できます。

2025年6月26日 / Gemma

これまでの Gemma モデルの成功をもとに、Gemma 3n モデルが完全リリースを迎えました。前例のないパフォーマンスを発揮する先進的なオンデバイス マルチモーダル機能を、エッジデバイスで利用できるようになります。モバイルファースト アーキテクチャ、MatFormer テクノロジー、Per-Layer Embeddings、KV キャッシュ共有、新しい音声エンコーダと MobileNet-V5 ビジョン エンコーダなど、Gemma 3n のイノベーションをご覧ください。デベロッパーが今すぐ開発を始める方法も紹介します。

2025年6月26日 / AI

Google は、Data Commons 用の新しい Python クライアント ライブラリをリリースしました。Data Commons は、公開統計データを一元的に扱えるようにするオープンソース ナレッジグラフです。ONE Campaign の貢献により、機能が改善され、カスタム インスタンスがサポートされ、幅広い統計変数を簡単に利用できるようになっています。これにより、データ デベロッパーが Data Commons を最大限に活用できるようになります。

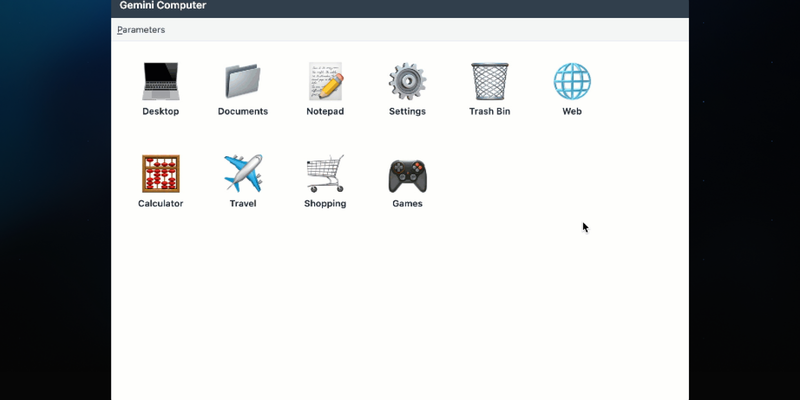

2025年6月25日 / Gemini

Gemini 2.5 Flash-Lite を使ってニューラル オペレーティング システムをシミュレーションする研究プロトタイプにより、ユーザーのインタラクションにリアルタイムで適応する UI を生成します。これは、インタラクションを追跡してコンテキストを認識したり、速度を上げるために UI をストリーミングしたり、インメモリ UI グラフを使ってステートフルを実現したりすることで可能になります。

2025年6月24日 / Gemini

新しい AI ファーストの Google Colab は、会話型コーディングのための反復クエリ、自律型ワークフローを実現する次世代データ サイエンス エージェント、簡単なコード変換などの機能改善によって生産性を向上させます。先行ユーザーは、生産性が劇的に向上し、ML プロジェクトを加速したり、コードをより迅速にデバッグしたり、高品質な視覚表現を簡単に作成したりできるようになると報告しています。

2025年6月24日 / Kaggle

KerasHub を使用すると、さまざまな機械学習フレームワーク間でモデル アーキテクチャと重みを組み合わせることができ、Hugging Face Hub などのソース(PyTorch で作成されたものを含む)のチェックポイントを Keras モデルに読み込んで JAX、PyTorch、TensorFlow で利用できるようになります。この柔軟性により、選択したバックエンド フレームワークを完全に制御しながら、コミュニティによってファインチューニングされた幅広いモデルを活用できます。

2025年6月24日 / Gemini

コーディング、推論、空間理解を含むマルチモーダル機能が強化された Gemini 2.5 Pro および Flash が、ロボティクスに変革を起こします。この 2 つのモデルは、安全性の向上とコミュニティ アプリケーションに重点を置いており、場面の意味の理解、ロボット制御コードの生成、Live API によるインタラクティブ アプリケーションの開発に役立てることができます。