Pada bulan Februari kami mengumumkan Gemma, keluarga model terbuka kami yang ringan dan canggih serta dibangun dari penelitian dan teknologi yang sama dengan yang digunakan untuk membuat model Gemini. Respons komunitas yang luar biasa – termasuk varian penyempurnaan yang mengesankan, notebook Kaggle, integrasi ke dalam alat dan layanan, urutan langkah RAG menggunakan database seperti MongoDB, dan masih banyak lagi – sungguh sangat menginspirasi.

Hari ini, kami sangat senang bisa mengumumkan penambahan pertama kami untuk keluarga Gemma, yang memperluas kemungkinan bagi developer ML untuk berinovasi secara bertanggung jawab: CodeGemma untuk tugas pelengkapan dan pembuatan kode serta mengikuti instruksi, dan RecurrentGemma, arsitektur yang dioptimalkan dengan efisien untuk eksperimen penelitian. Selain itu, kami juga membagikan beberapa update untuk Gemma dan ketentuan kami yang ditujukan untuk peningkatan berdasarkan masukan yang sangat berharga yang kami dengar dari komunitas dan mitra kami.

Memanfaatkan fondasi model Gemma kami, CodeGemma menghadirkan kemampuan coding yang kuat sekaligus ringan bagi komunitas. Model CodeGemma tersedia dalam varian pretrained 7B yang memiliki spesialisasi dalam tugas pelengkapan kode dan pembuatan kode, varian instruction-tuned 7B untuk chat kode dan mengikuti instruksi, dan varian pretrained 2B untuk pelengkapan kode secara cepat yang cocok dengan komputer lokal Anda. Model CodeGemma memiliki beberapa keunggulan:

Pelajari lebih lanjut tentang CodeGemma dalam laporan kami atau cobalah dalam panduan memulai ini.

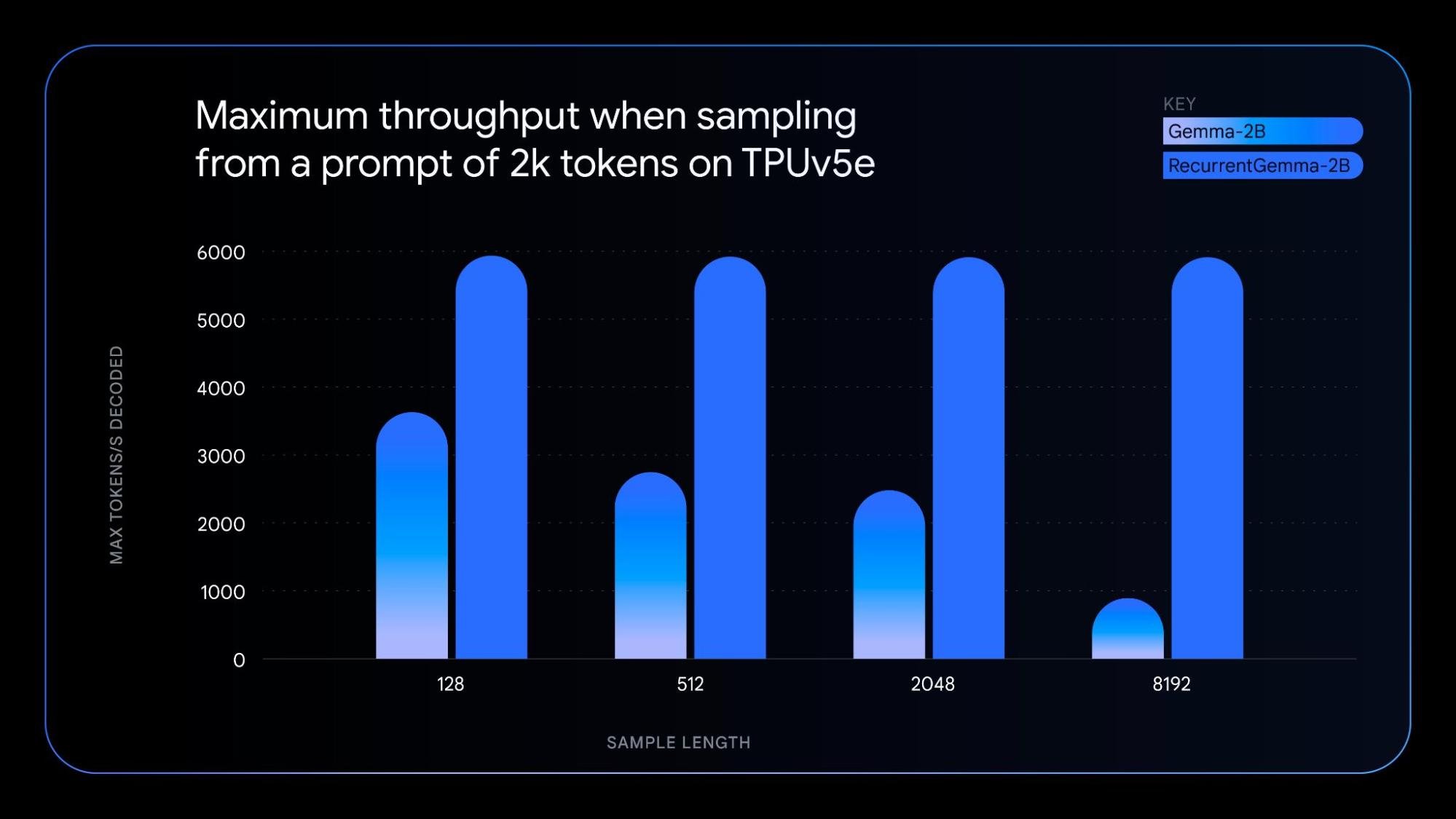

RecurrentGemma adalah model yang berbeda secara teknis yang memanfaatkan recurrent neural network dan atensi lokal untuk meningkatkan efisiensi memori. Selain mencapai performa skor tolok ukur yang serupa dengan model Gemma 2B, arsitektur unik RecurrentGemma menghasilkan beberapa keunggulan:

Untuk memahami teknologi yang mendasarinya, bacalah makalah kami. Untuk eksplorasi praktis, cobalah lihat notebook, yang menunjukkan cara menyempurnakan model.

Dipandu oleh prinsip yang sama dengan model asli Gemma, varian model baru ini menawarkan:

- CodeGemma dan RecurrentGemma: Dibangun dengan JAX dan kompatibel dengan JAX, PyTorch, Hugging Face Transformers, dan Gemma.cpp. Memungkinkan eksperimen lokal dan deployment yang hemat biaya di berbagai hardware, termasuk laptop, desktop, GPU NVIDIA, dan Google Cloud TPU.

- CodeGemma: Selain itu, kompatibel dengan Keras, NVIDIA NeMo, TensorRT-LLM, Optimum-NVIDIA, MediaPipe, dan ketersediaan di Vertex AI.

- RecurrentGemma: Dukungan untuk semua produk yang disebutkan di atas akan tersedia dalam beberapa minggu mendatang.

Bersamaan dengan varian model baru, kami merilis Gemma 1.1, yang mencakup peningkatan performa. Selain itu, kami juga mendengarkan masukan dari developer, memperbaiki bug, dan memperbarui ketentuan untuk memberikan fleksibilitas yang lebih tinggi.

Varian model Gemma pertama ini tersedia di berbagai tempat di seluruh dunia, mulai hari ini di Kaggle, Hugging Face, dan Vertex AI Model Garden. Berikut adalah cara memulainya:

Kami mengundang Anda untuk mencoba model CodeGemma dan RecurrentGemma serta membagikan masukan Anda tentang Kaggle. Bersama-sama, mari kita bentuk masa depan pemahaman dan pembuatan konten berteknologi AI.