39 結果

2025年10月30日 / AI

The blog post argues the request-response model fails for advanced multi-agent AI. It advocates for a real-time bidirectional streaming architecture, implemented by the Agent Development Kit (ADK). This streaming model enables true concurrency, natural interruptibility, and unified multimodal processing. ADK's core features are real-time I/O management, stateful sessions for agent handoffs, and streaming-native tools.

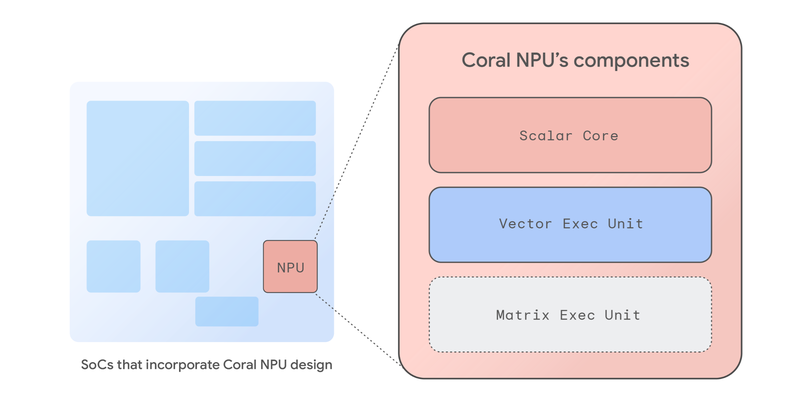

2025年10月15日 / AI

Coral NPU は、エッジ AI 向けのフルスタック プラットフォームであり、パフォーマンス、断片化、ユーザーの信頼度が低いといった課題に対処します。AI ファーストのアーキテクチャを採用し、ML マトリックスエンジンを優先し、統一されたデベロッパー エクスペリエンスを提供します。ウェアラブルおよび IoT において超低消費電力、常時稼働する AI 向けに設計されており、コンテキスト認識、音声 / 画像処理、そしてハードウェアによるプライバシー保護を備えたユーザー インタラクションを実現します。Synaptics 社は、Coral NPU を実装した最初のパートナーです。

2025年9月24日 / Mobile

Google AI Edge は、オンデバイスで AI 機能を実行するためのツールを提供しており、今回新しく追加された LiteRT-LM ランタイムは生成 AI を大きく前進させるものです。LiteRT-LM はオープンソースの C++ API であり、クロス プラットフォームの互換性とハードウェア アクセラレーションを備え、Gemma や Gemini Nano といった大規模言語モデルを幅広いハードウェア上で効率的に実行できるように設計されています。その革新性は、柔軟なモジュール アーキテクチャにあり、Chrome や Chromebook Plus の複雑なマルチタスク機能に対応する拡張性を持ちながら、Google Pixel Watch のようなリソースに制約のあるデバイスにも対応できます。この多用途性により、すでにオンデバイス生成 AI の新たな波がもたらされ、WebAI やスマートリプライといった機能がユーザーに提供されています。

2025年9月5日 / Mobile

Google AI Edge は、Gemma 3n プレビュー版を拡張して、音声サポートを追加しました。Play ストアでオープンベータ版として利用可能になった Google AI Edge Gallery を使用して、ご自分のスマートフォンで体験できます。

2025年7月24日 / AI

Apigee は、企業が大規模言語モデル(LLM)を既存の API エコシステムに安全かつスケーラブルに統合することを支援します。進化を続ける Model Context Protocol(MCP)ではカバーしきれない認証や認可といった課題に取り組むとともに、エンタープライズ向けの API セキュリティを AI エージェントに実装する方法を示す、オープンソースの MCP サーバーのサンプルも提供しています。

2025年7月23日 / Firebase

Firebase Studio で人気のあるフレームワークに新たな AI 機能が登場しました。AI に最適化されたテンプレート、Firebase バックエンド サービスとの効率的な統合のほか、ワークスペースをフォークして実験やコラボレーションを実現できます。これにより世界中のデベロッパーが AI 支援によるアプリ開発をさらに直感的かつスピーディに行えるようになります。

2025年7月16日 / Cloud

Marin プロジェクトは、開発プロセス全体をアクセス可能で再現可能なものにすることで、AI における「オープン」の定義をモデル自体にとどまらず科学的プロセス全体にまで拡張することを目指しています。この取り組みは JAX フレームワークとその Levanter ツールを活用しており、基盤モデルの詳細な精査、信頼性の確保、そのうえでの構築を可能にすることで、より透明性の高い AI 研究の未来を育みます。

2025年6月23日 / Cloud

Google は、Amazon や Cisco とともに、Linux Foundation に Agent2Agent Foundation を設立したことを発表しました。A2A を AI エージェントの相互運用性の業界基準として確立し、多様なエコシステムを育成し、中立的なガバナンスを確保して、AI アプリケーションの安全なイノベーションを加速します。

2025年5月20日 / Gemma

最先端のオープンモデル Gemma 3n は、オンデバイスで高速に動作するマルチモーダル AI として設計されています。最適化されたパフォーマンス、独自の 2-in-1 モデルによる柔軟性、オーディオによるマルチモーダル理解の強化といった特徴を持ち、インタラクティブなリアルタイム アプリケーションや洗練されたオーディオ中心のエクスペリエンスを開発できるようになっています。

2025年5月20日 / AI Edge

Google AI Edgeの進化には、新しいGemma 3モデルのほか、より幅広いモデル対応、オンデバイスでのRAGや関数呼び出しといった機能が含まれており、オンデバイスでの生成AI機能をさらに強化しています。