58 hasil

7 NOV. 2025 / AI

The Agent Development Kit (ADK), an open-source, code-first toolkit for building powerful and sophisticated AI agents, now supports Go. ADK moves LLM orchestration and agent behavior directly into your code, giving you robust debugging, versioning, and deployment freedom. ADK for Go is idiomatic and performant, leveraging Go's strengths, and includes support for over 30+ databases and the Agent-to-Agent (A2A) protocol for collaborative multi-agent systems. Start building today!

7 NOV. 2025 / AI

The new **User Simulation** feature in the Agent Development Kit (ADK) replaces rigid, brittle manual test scripts with dynamic, LLM-powered conversation generation. Developers define a high-level `conversation_plan`, and the simulator handles the multi-turn interaction to achieve the goal. This dramatically reduces test creation time, builds more resilient tests, and creates a reliable regression suite for AI agents.

15 OKT. 2025 / AI

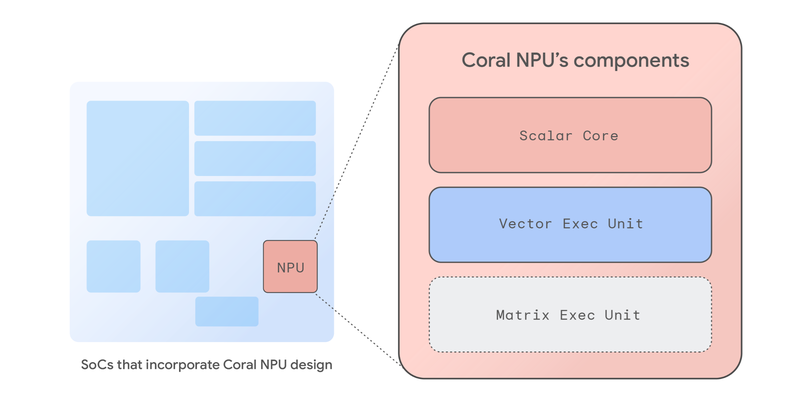

Coral NPU adalah platform full-stack untuk Edge AI, mengatasi masalah performa, fragmentasi, dan defisit kepercayaan pengguna. Ini adalah arsitektur yang mengutamakan AI, memprioritaskan mesin matriks ML, dan menawarkan pengalaman developer terpadu. Dirancang untuk AI yang sangat hemat daya dan selalu aktif di perangkat wearable dan IoT, Coral NPU memungkinkan kesadaran kontekstual, pemrosesan audio/gambar, dan interaksi pengguna dengan privasi yang diterapkan oleh hardware. Synaptics adalah mitra pertama yang mengimplementasikan Coral NPU.

15 OKT. 2025 / AI

Google merilis Veo 3.1 dan Veo 3.1 Fast, model pembuatan video terbaru, dalam pratinjau berbayar melalui Gemini API. Versi ini menawarkan audio asli yang lebih kaya, kontrol naratif yang lebih besar, dan kemampuan gambar-ke-video yang ditingkatkan. Fitur baru termasuk panduan pembuatan dengan gambar referensi, memperluas video Veo yang sudah ada, dan membuat transisi antar bingkai. Perusahaan seperti Promise Studios, Latitude, dan Whering telah menggunakan Veo 3.1 untuk berbagai aplikasi.

8 OKT. 2025 / Web

Panduan ini menunjukkan kepada Anda cara menyesuaikan model Gemma 3 270M untuk tugas-tugas khusus, seperti penerjemah emoji. Pelajari cara melakukan kuantisasi dan mengonversi model untuk penggunaan di perangkat, menerapkannya di aplikasi web dengan MediaPipe atau Transformers.js untuk pengalaman pengguna yang cepat, pribadi, dan dapat digunakan secara offline.

7 OKT. 2025 / AI

Untuk menghindari bottleneck data ketika melatih model besar, panduan ini memperkenalkan Grain dan ArrayRecord untuk membangun data pipeline berkinerja tinggi.

1 OKT. 2025 / AI

Citra multi-spektral, yang menangkap panjang gelombang di luar penglihatan manusia, menawarkan cara “manusia super” untuk memahami dunia, dan model Google Gemini membuatnya dapat diakses tanpa pelatihan khusus. Dengan memetakan band yang tak terlihat ke saluran RGB dan memberikan konteks dalam prompt, developer bisa memanfaatkan kekuatan Gemini untuk tugas-tugas, seperti pemantauan lingkungan dan pertanian.

25 SEP. 2025 / AI

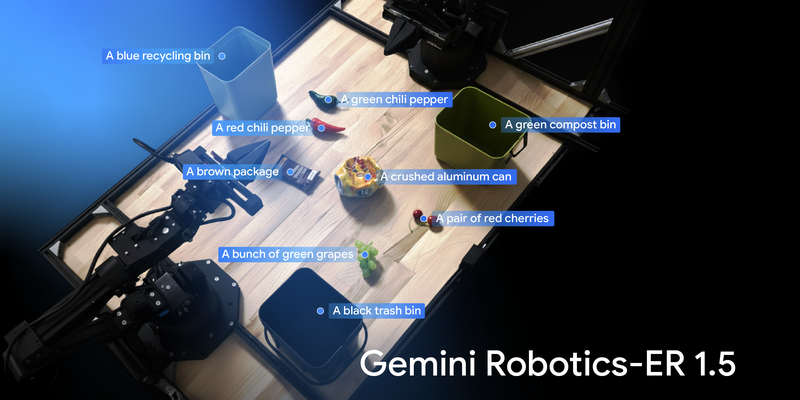

Gemini Robotics-ER 1.5, kini tersedia untuk developer, merupakan model penalaran termutakhir untuk robot. Model ini unggul dalam pemahaman visual, spasial, perencanaan tugas, dan estimasi progres, memungkinkan robot melakukan tugas multi-langkah yang kompleks.

24 SEP. 2025 / AI

Data Commons mengumumkan ketersediaan Server MCP, yang merupakan milestone utama dalam membuat semua set data publik Data Commons yang sangat besar bisa diakses secara instan dan dapat ditindaklanjuti oleh developer AI di seluruh dunia.

16 SEP. 2025 / AI

Rilis 0.2.0 terbaru Agent Development Kit (ADK) untuk Java dari Google menambahkan integrasi dengan ...