95 resultados

16 DE JULIO DE 2025 / Gemini

El Agent Development Kit (ADK) actualizado simplifica y acelera el proceso de creación de agentes de IA proporcionando a la CLI una comprensión profunda y rentable del marco de trabajo del ADK, lo que permite a los desarrolladores crear, generar, probar y mejorar rápidamente los agentes funcionales a través de indicaciones conversacionales, con lo que se elimina la fricción y se mantiene a los agentes en un estado de “flujo” productivo.

16 DE JULIO DE 2025 / AI

La función "logprobs" se introdujo oficialmente en la API de Gemini en Vertex AI. Proporciona información sobre la toma de decisiones del modelo al mostrar puntajes de probabilidad para tokens elegidos y alternativos. Esta guía paso a paso te mostrará cómo habilitar e interpretar esta función, y aplicarla a casos de uso poderosos, como la clasificación segura, el autocompletado dinámico y la evaluación cuantitativa de RAG.

16 DE JULIO DE 2025 / Cloud

El proyecto Marin tiene como objetivo ampliar la definición de "abierto" en IA para incluir todo el proceso científico, no solo el modelo en sí, haciendo que el proceso de desarrollo completo sea accesible y reproducible. Esta iniciativa, impulsada por el framework JAX y su herramienta Levanter, permite realizar un profundo escrutinio, confiar y compilar sobre modelos básicos, fomentando un futuro más transparente para la investigación en IA.

14 DE JULIO DE 2025 / Cloud

El concentrador de APIs de Apigee y los portales para desarrolladores son partes distintas, pero interconectadas, de la plataforma Apigee que ayudan a las organizaciones a descubrir y administrar APIs para diferentes perfiles ficticios, revelando el potencial de la API y acelerando la innovación.

10 DE JULIO DE 2025 / Gemini

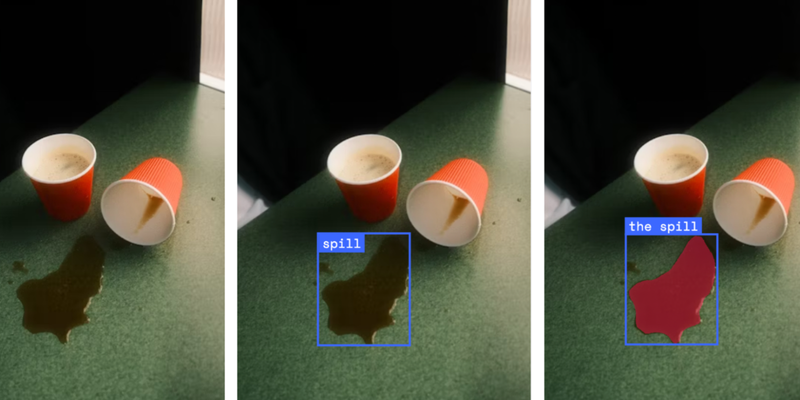

GenAI Processors es una nueva biblioteca Python de código abierto de Google DeepMind diseñada para simplificar el desarrollo de aplicaciones de IA, especialmente aquellas que manejan entradas multimodales y requieren capacidad de respuesta en tiempo real, al proporcionar una interfaz de “procesador” coherente para todos los pasos, desde el manejo de entradas hasta el procesamiento de llamadas y salidas de modelos, para un encadenamiento sin interrupciones y una ejecución simultánea.

26 DE JUNIO DE 2025 / Gemma

El modelo Gemma 3n se lanzó por completo, aprovechando el éxito de los modelos Gemma anteriores y brindando capacidades multimodales integradas y avanzadas a dispositivos perimetrales con un rendimiento sin precedentes. Explora las innovaciones de Gemma 3n, incluida su arquitectura que prioriza los dispositivos móviles, la tecnología MatFormer, incorporaciones por capas, el uso compartido de caché KV y los nuevos codificadores de audio y visión MobileNet-V5, y cómo los desarrolladores pueden comenzar a crear hoy mismo.

24 DE JUNIO DE 2025 / Gemini

Gemini 2.5 Pro y Flash están transformando la robótica a través de la mejora de la codificación, el razonamiento y las capacidades multimodales, incluida la comprensión espacial. Estos modelos se utilizan para la comprensión semántica de escenas, la generación de código para el control de robots y la creación de aplicaciones interactivas con la API Live, con un fuerte énfasis en las mejoras de seguridad y las aplicaciones comunitarias.

10 DE JUNIO DE 2025 / Web

If you are developing or maintaining a checkout page you might come across PCI DSS v4, which requires specific management of payment page scripts, including authorization, integrity assurance, and inventory with justification.

20 DE MAYO DE 2025 / Gemma

Gemma 3n es un modelo abierto de vanguardia, diseñado para una IA rápida y multimodal en dispositivos que ofrece un rendimiento optimizado, una flexibilidad única con un modelo 2 en 1 y una comprensión multimodal ampliada con audio, lo que permite a los desarrolladores compilar aplicaciones interactivas en vivo y sofisticadas experiencias centradas en el audio.

20 DE MAYO DE 2025 / AI Edge

Se implementaron mejoras en LiteRT para aumentar el rendimiento y la eficiencia del modelo de IA en dispositivos móviles mediante la utilización efectiva de GPU y NPU, que ahora requieren mucho menos código, lo que permite una selección simplificada del acelerador de hardware y ofrece más capacidades para lograr un rendimiento óptimo en el dispositivo.